استعراض Tenable One AI Exposure: معيار جديد لتأمين استخدام الذكاء الاصطناعي على نطاق واسع

يمكنك اكتشاف جميع استخدامات الذكاء الاصطناعي ومراقبتها باستمرار عبر مؤسستك، بما في ذلك الاستخدام غير المُصرح به للذكاء الاصطناعي والوكلاء والمكونات الإضافية للمتصفح وغير ذلك، باستخدام أداة Tenable One AI Exposure. إذ يمكنك تخطيط عمليات سير العمل المعقدة للذكاء الاصطناعي، للكشف عن حالات التعرض للمخاطر عالية التأثير ومراقبة الامتثال للسياسات الأمنية وسياسات الاستخدام المقبول للذكاء الاصطناعي.

أهم النقاط الرئيسية

- أصبحت أداة Tenable One AI Exposure متوفرة الآن بشكل عام ضمن منصة Tenable One Exposure Management، لتمكين فرق الأمن من مراقبة عمليات سير العمل المدعومة بالذكاء الاصطناعي وتأمينها.

- تتيح هذه الأداة تخطيط عمليات سير العمل المعقدة للذكاء الاصطناعي، للكشف عن كيفية اجتماع التطبيقات والبنية التحتية والهوية والوكلاء والبيانات، بما يؤدي إلى إنشاء حالات تعرض للمخاطر عالية التأثير.

- تُساعد في الحماية من مخاطر الذكاء الاصطناعي، مثل هجمات حقن الأوامر ومحاولات اختراق الحماية، مع تحديد البيانات الحساسة الجاري مشاركتها عبر أوامر الذكاء الاصطناعي.

لقد تجاوز التكامل السريع للذكاء الاصطناعي عبر التطبيقات والبنية التحتية نطاق الإشراف الأمني التقليدي. ونظرًا لاعتماد الوكلاء المستقلين والذكاء الاصطناعي المعتمد على السحابة كعناصر أساسية داخل المؤسسة، تواجه فرق الأمن صعوبة في إدارة فئة جديدة من المخاطر التي لم تُصمَّم الأدوات القديمة لرصدها — ما يُنشئ فجوة حرجة في إدارة التعرض لمخاطر الذكاء الاصطناعي.

نُعلن اليوم عن إطلاق أداة Tenable One AI Exposure لتزويد فرق الأمن بالإمكانات اللازمة لسد هذه الفجوة والتخفيف من حدة المخاطر الأمنية المُتعلقة بالذكاء الاصطناعي. وبفضل توفر هذه الإمكانات الآن بشكل عام ضمن منصة Tenable One Exposure Management ، يُمكن للمؤسسات تأمين عمليات سير العمل المدعومة بالذكاء الاصطناعي دون إبطاء الابتكار.

شرح فجوة إدارة التعرض للمخاطر المتعلقة بالذكاء الاصطناعي

تُشير فجوة إدارة التعرض للمخاطر المتعلقة بالذكاء الاصطناعي إلى ثلاثة تحديات تواجه فرق الأمن: مدى قدرتها على رؤية طريقة استخدام الموظفين للذكاء الاصطناعي، وأماكن تشغيله، وكيفية تراكم حالات التعرض للمخاطر المتعلقة بالذكاء الاصطناعي عبر الأنظمة المترابطة — سواء أكان ذلك داخل المؤسسة أم خارجها.

يصعب تقييم حالات التعرض للمخاطر المتعلقة بالذكاء الاصطناعي لعدة أسباب. أولًا، هذا النوع من التعرض للمخاطر لا يشبه المخاطر الإلكترونية التقليدية. إذ إنه لا يتركز في نظام واحد. ولا يظهر كثغرة أمنية. ولا ينتظر أن يستغله مرتكبو الهجوم قبل أن يتسبب في ضرر. وتظهر المخاطر الأمنية المتعلقة بالذكاء الاصطناعي فيما يلي:

- منصات الذكاء الاصطناعي المتاحة للموظفين مثل ChatGPT وCopilot والميزات المضمنة في تطبيقات SaaS

- خدمات الذكاء الاصطناعي المعتمدة على السحابة وتدفقات النماذج

- واجهات برمجة التطبيقات (APIs) والوكلاء والمكونات الإضافية للمتصفح

- التطبيقات والخدمات المتاحة للعامة

يحدث جزء كبير من هذا الاعتماد خارج نطاق عمليات سير العمل الأمنية التقليدية. إذ تؤدي عمليات نشر الاستخدام غير المصرح به للذكاء الاصطناعي، وبيئات الاختبار المنسية، وعمليات التكامل غير الآمنة، والخدمات ذات الصلاحيات المُفرطة إلى توسيع سطح الهجوم بهدوء، وغالبًا دون أن تدرك فرق الأمن وجودها.

وفي الوقت نفسه، تعتمد أعباء عمل الذكاء الاصطناعي على سلاسل مُعقدة من البنية التحتية والهويات وواجهات برمجة التطبيقات (API) وإمكانيات الوصول إلى البيانات. ويمكن أن يحول تكوين غير صحيح واحد أو منح أذونات واسعة النطاق استخدامًا اعتياديًا للذكاء الاصطناعي إلى حالة تعرض للمخاطر عالية التأثير.

نظرًا لأن تفاعلات الذكاء الاصطناعي تحدث بشكل مستمر عبر الأوامر وعمليات التحميل والردود والإجراءات المؤتمتة، فقد يؤدي حتى الاستخدام المُعتمد إلى الكشف عن بيانات حساسة بشكل غير مقصود، إذا لم تتوفر الرؤية المناسبة والحواجز الأمنية.

وأخيرًا، نادرًا ما تظهر حالات التعرض للمخاطر المتعلقة بالذكاء الاصطناعي على شكل تنبيه واحد أو أصل عُرضة للمخاطر بمفرده. بل تنشأ عادةً من خلال الروابط بين المكونات. على سبيل المثال:

- استخدام الموظف لأداة معتمدة من جهات خارجية

- استدعاء تلك الأداة لوكيل أو خدمة ذكاء اصطناعي داخلية

- تمتع الوكيل بإمكانية الوصول إلى بيانات أو أنظمة حساسة

- تكوين غير صحيح أو نقطة نهاية مكشوفة تجعل هذا الوصول ممكنًا

وعلى المستوى الفردي، قد يبدو كل مكون غير خطِر. ولكن عند تجميعها معًا، فإنها تُنشئ مخاطر حقيقية.

تميل أدوات الأمان التقليدية إلى فجص هذه العناصر بمعزل عن غيرها: الوضع السحابي هنا، وأذونات الهوية هناك، ومخاطر التطبيقات في مكان آخر. ودون وسيلة لربط هذه الإشارات معًا، تُترك فرق الأمن تتعامل مع الأعراض بدلًا من إدارة التعرض للمخاطر.

استعراض Tenable One AI Exposure

تُساعد أداة Tenable One AI Exposure فرق الأمن على سد هذه الثغرة الأمنية في الرؤية من خلال الاكتشاف المستمر لحالات التعرض للمخاطر المتعلقة بالذكاء الاصطناعي، ووضعها في سياقها الصحيح، وتحديد أولوياتها عبر مؤسستك بالكامل — داخليًا وخارجيًا، وفي مكان العمل وفي السحابة — بما يوفر طريقة عرض كاملة وواعية بالمخاطر عن أماكن تشغيل الذكاء الاصطناعي وروابطه والأماكن التي ينشأ فيها حالات التعرض للمخاطر.

وعلى عكس أدوات الأمن الإلكتروني الخاصة بالذكاء الاصطناعي أحادية الغرض التي تُظهر نتائج معزولة، تربط منصة Tenable One سلسلة النشاط بالكامل في طريقة عرض واحدة، موضحة كيفية اجتماع تطبيقات الذكاء الاصطناعي وبنيته التحتية وهويته ووكلائه وبياناته لإنشاء مخاطر حقيقية. ومن خلال ربط هذه العلاقات، تساعد منصة Tenable One فرق الأمن لديك على تحديد أولويات حالات التعرض للمخاطر المتعلقة بالذكاء الاصطناعي الأكثر أهمية، لتقليل مخاطره الأمنية عبر جميع البيئات.

دور منصة Tenable One في تأمين سطح هجوم الذكاء الاصطناعي

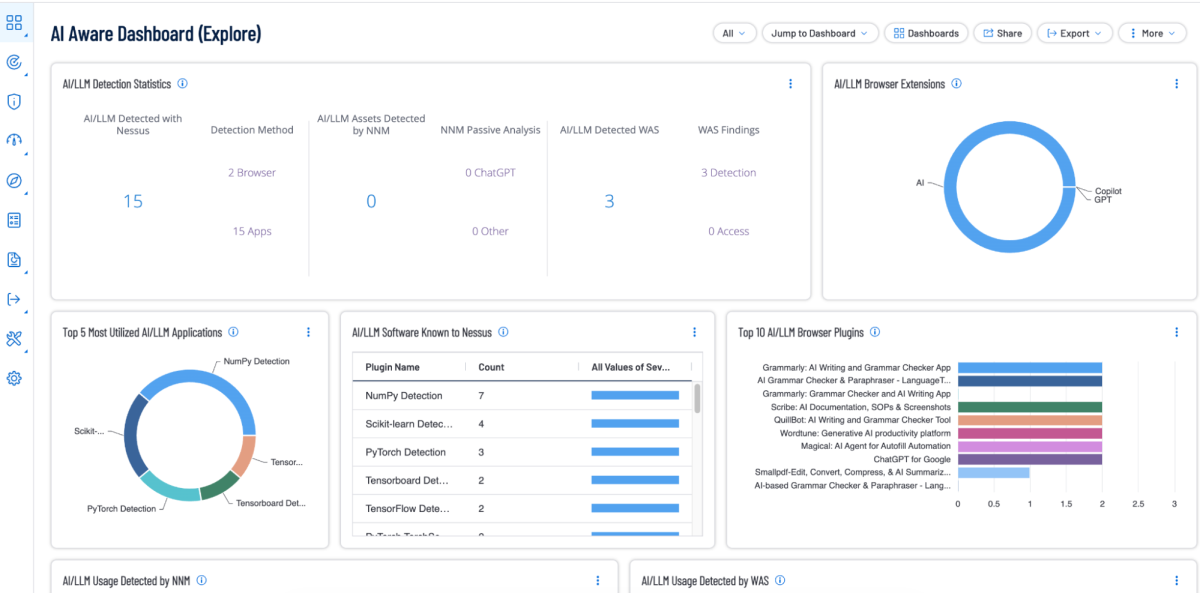

اكتشف استخدامات الذكاء الاصطناعي عبر مؤسستك

لا يُمكنك إدارة المخاطر المتعلقة بالذكاء الاصطناعي إذا لم تكن تعلم أماكن وجودها.

تكتشف منصة Tenable One استخدامات الذكاء الاصطناعي باستمرار عبر البيئات الداخلية وسطح الهجوم الخارجي، مما يُساعد الفرق على التخلص من النقاط العمياء والحفاظ على فهم مُحدّث لبصمة واستخدام الذكاء الاصطناعي الخاصة بهم. ويشمل ذلك رؤية كل من الاستخدام المصرح به والاستخدام غير المصرح به للذكاء الاصطناعي عبر التطبيقات ونقاط النهاية وأعباء عمل السحابة وواجهات برمجة التطبيقات (API) والوكلاء والخدمات المكشوفة علنًا.

يُمكن لفرق الأمن الاطلاع على أماكن تشغيل خدمات الذكاء الاصطناعي والتقنيات المستخدمة وكيفية توافق حالات التعرض للمخاطر الخارجية مع الوعي الداخلي.

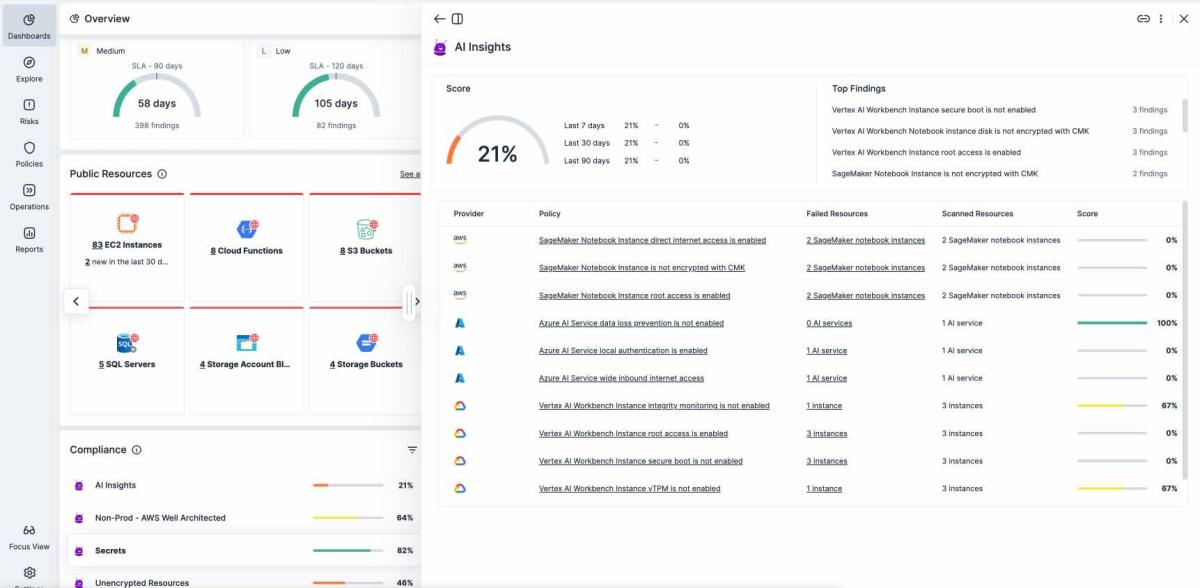

فهم كيفية إنشاء الذكاء الاصطناعي لحالات التعرض للمخاطر

إن الاكتشاف وحده لا يكفي. إذ أن المخاطر المتعلقة بالذكاء الاصطناعي تنشأ من كيفية تفاعل الأنظمة مع بعضها البعض.

تُخطط منصة Tenable One عمليات سير عمل الذكاء الاصطناعي عبر المنصات والخدمات السحابية، لتكشف عن كيفية عمل نماذج الذكاء الاصطناعي وبنيته التحتية وتخزينه وشبكاته والتحكم في الوصول إليه معًا. وتُبرزالثغرات الأمنية والتكوينات غير الصحيحة في البرامج والموارد السحابية المتعلقة بالذكاء الاصطناعي، مع توفير سياق عن البيانات والأنظمة التي يمكن لتلك المكونات الوصول إليها.

تكتسب الفرق وضوحًا بشأن أماكن إنشاء حالات التعرض للمخاطر الفعلية، وليس فقط أماكن وجود الذكاء الاصطناعي، من خلال ربط البنية التحتية للذكاء الاصطناعي بمسارات الهوية والوصول.

حماية أعباء عمل الذكاء الاصطناعي وخدماته وصلاحيات الوصول إليه

إن تقليل المخاطر المتعلقة بالذكاء الاصطناعي يعني التخلص من الثغرات التي يستغلها مرتكبو الهجوم.

تُساعد منصة Tenable One الفرق على تحديد التكوينات المحفوفة بالمخاطر ومعالجتها في أعباء عمل الذكاء الاصطناعي وبيئات النماذج قبل إساءة استخدامها. وتكشف أيضًا عن الأذونات المفرطة ونقاط ضعف الهوية المرتبطة بخدمات الذكاء الاصطناعي ووكلائه، مما يتيح للفرق تطبيق مبدأ أقل الامتيازات في الوصول وتقليل مسارات الهجوم التي تُعرّض الموارد الحيوية للذكاء الاصطناعي للمخاطر.

تتيح هذه الرؤية لفرق الأمن التركيز على حالات التعرض للمخاطر المستندة إلى الهوية، وتحديد مجموعات نقاط الضعف الأكثر أهمية.

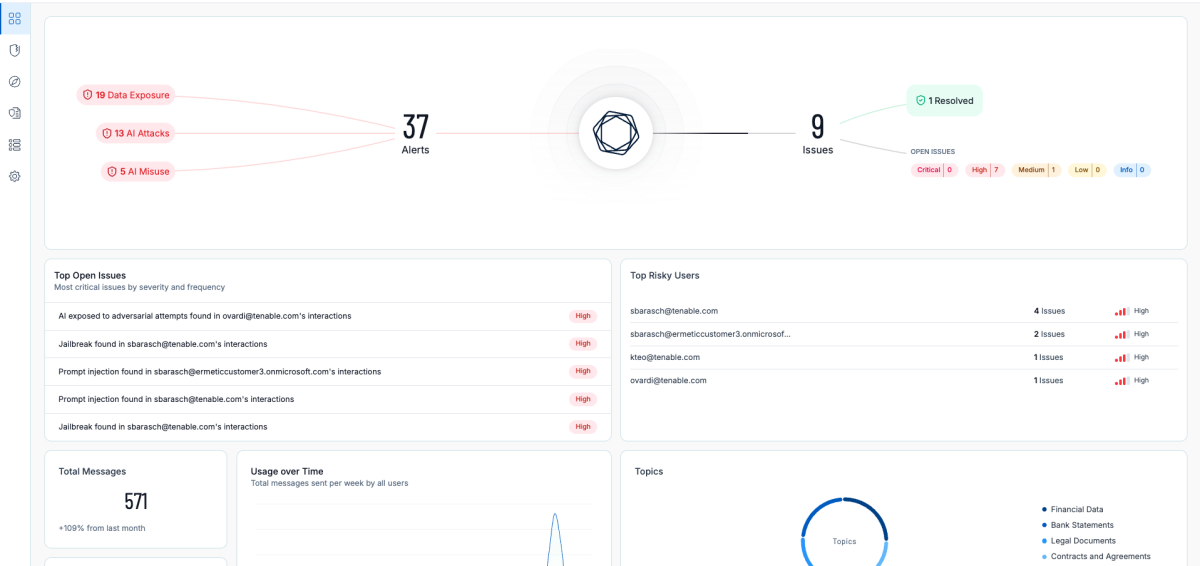

حوكمة استخدام الذكاء الاصطناعي وتدفق البيانات

لا يجب أن يأتي اعتماد الذكاء الاصطناعي على حساب الأمن أو الامتثال.

توفر منصة Tenable One الرؤية لكيفية تفاعل الموظفين والوكلاء مع منصات الذكاء الاصطناعي، بما في ذلك أدوات مثل ChatGPT وCopilot وميزات الذكاء الاصطناعي التوليدي المضمنة. وتوضح أيضًا كيفية تدفق البيانات عبر هذه التفاعلات. ويمكن للفرق تحديد البيانات الحساسة التي تتم مشاركتها عبر الأوامر أو التحميلات، وفرض سياسات الاستخدام المقبول للذكاء الاصطناعي، وتطبيق حواجز أمنية توجه المستخدمين نحو سلوك أكثر أمانًا عند استخدام الذكاء الاصطناعي.

وتكشف المنصة أيضًا عن التهديدات وإساءة الاستخدام الخاصة بالذكاء الاصطناعي، مثل هجمات حقن الأوامر ومحاولات اختراق الحماية، وتوفر سياقًا عالي الدقة لدعم استجابة سريعة وواثقة.

تأمين اعتماد الذكاء الاصطناعي دون إبطاء الابتكار

لا يجب أن يكون الذكاء الاصطناعي بمثابة أكبر نقطة عمياء لديك، ولا أن يكون الأمان عائقًا أمام الابتكار. فبفضل أداة Tenable One AI Exposure، يمكن للمؤسسات المضي قدمًا بثقة، مع علمها بأنها تعتمد نهجًا استباقيًا يسبق وقوع الاختراق لإدارة المخاطر المتعلقة بالذكاء الاصطناعي عبر سطح الهجوم بالكامل.

هل أنت جديد في Tenable؟اطلب إصدارًا تجريبيًا من Tenable One AI Exposure اليوم.

هل أنت عميل حالي؟ تواصل مع فريق الحساب لديك لتوسيع تغطية منصة Tenable One لتشمل حالات التعرض للمخاطر المتعلقة بالذكاء الاصطناعي.

- Exposure Management